Professional Documents

Culture Documents

Bayesiana Buena

Uploaded by

acadropCopyright

Available Formats

Share this document

Did you find this document useful?

Is this content inappropriate?

Report this DocumentCopyright:

Available Formats

Bayesiana Buena

Uploaded by

acadropCopyright:

Available Formats

Mtodos de

Inteligencia Artificial

L. Enrique Sucar (INAOE)

esucar@inaoep.mx

ccc.inaoep.mx/esucar

Tecnologas de Informacin

UPAEP

Redes Bayesianas: Parte I

Introduccin

Representacin

Inferencia

Propagacin en rboles

Representacin

Las redes bayesianas son una

representacin grfica de dependencias

para razonamiento probabilstico, en la cual

los nodos y arcos representan:

Nodos: Variables proposicionales.

Arcos: Dependencia probabilstica

La variable a la que apunta el arco es

dependiente (causa-efecto) de la que est

en el origen de ste.

Ejemplo de una red bayesiana

Borracho

Sed

Dolor-Cabeza

Vino

MGP - RB I, L.E. Sucar 5

Otro ejemplo

Inuenza

Fiebre

Dolor-Cabeza

Contagio

1. Distribucin de probabilidad:

Representa la distribucin de la probabilidad

conjunta de las variables representadas en la

red.

Podemos interpretar a una RB de dos formas:

Por ejemplo:

P(C, I, F, D) = P(C) P(I | C) P(F | I) P (D | I)

2. Base de reglas:

Cada arco representa un conjunto de reglas

que asocian las variables involucradas,

Por ejemplo:

Si I entonces F

Dichas reglas estn cuantificadas por

las probabilidades respectivas.

Otro ejemplo

Estructura

La topologa o estructura de la red nos da

informacin sobre las dependencias

probabilsticas entre las variables.

La red tambin representa las independencias

condicionales de una variable (o conjunto de

variables) dada otra variable(s).

Ejemplo

Para el caso del domo:

{Fva} es cond. indep. de {Fv, Fe, Nd} dado {Fb}

Esto es:

P(Fva | Fv, Fe, Nd, Fb)= P(Fva | Fb)

Esto se representa grficamente por el nodo Fb separando al

nodo Fva del resto de las variables.

Independencias condicionales

En una RB todas la relaciones de independencia condicional

representadas en el grafo corresponden a relaciones de

independencia en la distribucin de probabilidad.

Dichas independencias simplifican la representacin del

conocimiento (menos parmetros) y el razonamiento

(propagacin de las probabilidades).

Representacin Grfica

Una red bayesiana representa en forma

grfica las dependencias e independencias

entre variables aleatorias, en particular las

independencias condicionales

Independencia en la distribucin

P(X | Y,Z) = P(X | Z)

Independencia en el grafo

X separada de Y por Z

Representacin Grfica

Notacin:

Independencia en la distribucin

I(X,Z,Y)

Independencia en el grafo

< X | Z | Y >

X Z Y

Separacin D

El conjunto de variables A es

independiente del conjunto B dado el

conjunto C, si no existe trayectoria entre

A y B en que

1. Todos los nodos convergentes estn o tienen

descendientes en C

2. Todos los dems nodos estn fuera de C

Separacin D

Tres casos bsicos

Arcos divergentes

Arcos en secuencia

Arcos convergentes

Separacin D casos bsicos

caso 1: Secuencia:

X Z Y

caso 2: Divergentes:

caso 3: Convergentes:

X Z Y

X Z Y

Ejemplos Separacin-D

A

D

C

F G

B

E

I(A,CD,F)?

I(A,CD,B)?

I(BD,A,C)?

I(A,G,B)?

I(A,D,G)?

I(C,BEG,D)?

Especificacin Estructural

En una RB, cualquier nodo X es

independiente de todos los nodos que no

son sus descendientes dados sus nodos

padres Pa(X) contorno de X

La estructura de una RB se especifica

indicando el contorno (padres) de cada

variable

Especificacin Estructural

A

D

C

F G

B

E

Pa(A) = 0

Pa(B) = 0

Pa(C) = A

Pa(D) = A, B

Pa(E) = B

Pa(F) = C, D

Pa(G) = D

Cobija de Markov

La cobija de Markov de un nodo es el

conjunto de nodos que lo hacen

independiente del resto de la red

Para una RB la cobija de Markov est

formada por:

Nodos padre

Nodos hijo

Otros padres de los hijos

Cobija de Markov

A

D

C

F G

B

E

CM (D) ?

Parmetros

Complementan la definicin de una red

bayesiana las probabilidades condicionales

de cada variable dados sus padres.

Nodos raz: vector de probabilidades

marginales

Otros nodos: matriz de probabilidades

condicionales dados sus padres

P(C)

P(T|C)

P(G)

P(R|T)

P(F|T,G)

Comida

Gripe

Tifoidea

Fiebre Dolor

Reacciones

P(D|T,G)

Ejemplo

P(C)

P(T|C)

P(G)

P(R|T)

P(F|T,G)

Comida

Gripe

Tifoidea

Fiebre Dolor

Reacciones

P(D|T,G)

Ejemplo

0.8 0.2

Sal Ins

P(C)

P(T|C)

P(G)

P(R|T)

P(F|T,G)

Comida

Gripe

Tifoidea

Fiebre Dolor

Reacciones

P(D|T,G)

0.8 0.2

Sal Ins

.9 .3 No

.1 .7 Si

Sal Ins

P(C)

P(T|C)

P(G)

P(R|T)

P(F|T,G)

Comida

Gripe

Tifoidea

Fiebre Dolor

Reacciones

P(D|T,G)

0.8 0.2

Sal Ins

.9 .3 No

.1 .7 Si

Sal Ins

0.9 0.5 0.4 0.2 ~F

0.1 0.5 0.6 0.8 F

No,No No,Si Si,No Si, Si

Especificacin Paramtrica

Dado que los contornos (padres) de cada nodo especifican

la estructura, mediante las probabilidades condicionales de

dichos nodos podemos especificar tambin las

probabilidades requeridas

Aplicando la regla de la cadena y las independencias

condicionales, se puede verificar que con dichas

probabilidades se puede calcular la probabilidad conjunta

Especificacin Paramtrica

A

D

C

F G

B

E

P(A,B,C,D,E,F,G)

= P(G|F,E,D,C,B,A) P(F|E,D,C,B,A) P(E|D,C,B,A)

P(D|C,B,A) P(C|B,A) P(B|A) P(A)

= P(G|D) P(F|D,C) P(E|B) P(D|B,A) P(C|A) P(B) P(A)

Especificacin Paramtrica

En general, la probabilidad conjunta se

especifica por el producto de las

probabilidades de cada variable dados sus

padres:

P(X1,X2, ..., Xn) = ! P(Xi | Pa(Xi))

Inferencia probabilstica

En RB, la inferencia probabilstica consiste en:

dadas ciertas variables conocidas (evidencia), calcular la

probabilidad posterior de las dems variables

(desconocidas)

Es decir, calcular: P(Xi | E), donde:

E es un subconjunto de variables de la RB (posiblemente vaci)

Xi es cualquier variable en la RB, no en E

Inferencia bayesiana

C

H

E

P(H|C)

P(E|H)

Causal:

C ! H

Evidencial:

E ! H

Mixta:

C, E ! H

Tipos de Tcnicas

Calcular probabilidades posteriores:

Una variable, cualquier estructura: algoritmo

de eliminacin (variable elimination)

Todas las variable, estructuras sencillamente

conectadas (rboles, polirboles): propagacin

Todas las variables, cualquier estructura:

Agrupamiento (junction tree)

Simulacin estocstica

Condicionamiento

Tipos de Tcnicas

Obtener variable(s) de mayor probabilidad

dada cierta evidencia abduccin:

Abduccin total

Abduccin parcial

Tipos de estructuras

Sencillamente

conectadas

rboles

Polirboles

Multiconectadas

Cada nodo corresponde a una variable

discreta, B (B

1

, B

2

,, B

m

) con su

respectiva matriz de probabilidad

condicional, P(B|A)=P(B

j

| A

i

)

Propagacin en rboles

Propagacin en rboles

A

D

C

F

G

B

E

H

I

Dada cierta evidencia E -representada por la

instanciacin de ciertas variables- la

probabilidad posterior de cualquier variable

B, por el teorema de Bayes:

P( B

i

| E)=P( B

i

) P(E | B

i

) / P( E )

B

Evidencia

A

D

C

F

G

B

E

H

I

E = {I,F,E}

Ya que la estructura de la red es un rbol, el

Nodo B la separa en dos subrboles, por lo

que podemos dividir la evidencia en dos

grupos:

E-: Datos en el rbol que cuya raz es B

E+: Datos en el resto del rbol

Evidencia

Evidencia

A

D

C

F

G

B

E

H

I

E+

E-

Entonces:

P( B

i

| E ) = P ( B

i

) P ( E

-

,E

+

| B

i

) / P(E)

Pero dado que ambos son independientes y

aplicando nuevamente Bayes:

P( B

i

| E ) = " P ( B

i

| E

+

) P(E

-

| B

i

)

Donde " es una constante de normalizacin

Si definimos los siguientes trminos:

Definiciones:

# (B

i

) = P ( E

-

| B

i

)

Entonces:

$ (B

i

) = P (B

i

| E

+

)

P(B

i

| E ) = " $ (B

i

) # (B

i

)

Desarrollo

En base a la ecuacin anterior, se puede

integrar un algoritmo distribuido para

obtener la probabilidad de un nodo dada

cierta evidencia

Para ello se descompone el clculo de cada

parte:

Evidencia de los hijos (#)

Evidencia de los dems nodos ($)

Evidencia de los hijos (l )

Dado que los hijos son condicionalmente

independientes dado el padre:

# (B

i

) = P ( E

-

| B

i

) = !

k

P ( E

k

-

| B

i

)

Donde E

k

-

corresponde a la evidencia del

subrbol del hijo k

Evidencia

hijos

A

D

C

F

G

B

E

H

I

E-(D)

E-(E)

J

Evidencia de los hijos (#)

Condicionando respecto a los posibles

valores de los hijos de B:

# (B

i

)= !

k

[ %

j

P ( E

k

-

| B

i

, S

j

k

) P(S

j

k

| B

i

) ]

Donde S

k

es el hijo k de B, y la sumatoria es

sobre los valores de dicho nodo (teorema de

probabilidad total)

Evidencia de los hijos (#)

Dado que B es condicionalmente

independiente de la evidencia dados sus hijos:

# (B

i

) = !

k

[ %

j

P ( E

k

-

| S

j

k

) P(S

j

k

| B

i

) ]

Substituyendo la defincin de #:

# (B

i

)= !

k

[ %

j

P(S

j

k

| B

i

) # (S

j

k

)]

Evidencia

hijos

A

D

C

F

G

B

E

H

I

#(E)

#(D)

Evidencia de los hijos (l )

Recordando que # es un vector (un valor por

cada posible valor de B), lo podemos ver en

forma matricial:

# = # P (S | B)

Evidencia de los dems nodos ($)

Condicionando sobre los diferentes valores

del nodo padre (A):

$ (B

i

) = P (B

i

| E

+

) = %

j

P (B

i

| E

+

, A

j

) P(A

j

| E

+

)

Donde A

j

corresponde a los diferentes valores

del nodo padre de B

Evidencia

padre

A

D

C

F

G

B

E

H

I E+

Evidencia de los dems nodos (p)

Dado que B es independiente de la evidencia arriba de A,

dado A:

! (B

i

) = %

j

P (B

i

| A

j

) P(A

j

| E

+

)

La P(A

j

| E

+

) corresponde a la P posterior de A dada toda la

evidencia excepto B y sus hijos, por lo que se puede escribir

como:

P(A

j

| E

+

) = " $ (A

i

) !

k! B

#

k

(A

i

)

Evidencia

padre

A

D

C

F

G

B

E

H

I

#(C)

#(B)

$(A)

Evidencia de los dems nodos ($)

Substituyendo P(A

j

| E

+

) en la ecuacin de $ :

$ (B

i

) = %

j

P (B

i

| A

j

) [ " $ (A

i

) !

k! B

#

k

(A

i

) ]

De forma que se obtiene combinando la $ de

del nodo padre con la # de los dems hijos

Evidencia de los dems nodos (p)

Dado que tambin $ es un vector, lo podemos ver en forma

matricial (donde P

A

es el producto de la evidencia de padre y

otros hijos):

$ = P (B | A) P

A

Algoritmo

Mediante estas ecuaciones se integra un

algoritmo de propagacin de

probabilidades en rboles.

Cada nodo guarda los valores de los

vectores $ y #, as como su matriz de

probabilidad condicional (CPT), P.

La propagacin se hace por un mecanismo

de paso de mensajes, en donde cada nodo

enva los mensajes correspondientes a su

padre e hijos

Mensaje al padre (hacia arriba)

nodo B a su padre A:

Mensaje a los hijos (hacia abajo) -

nodo B a su hijo S

k

:

Algoritmo

Al instanciarse ciertos nodos, stos envan

mensajes a sus padres e hijos, y se propagan hasta

a llegar a la raz u hojas, o hasta encontrar un

nodo instanciado.

As que la propagacin se hace en un solo paso,

en un tiempo proporcional al dimetro de la red.

Propagacin

#

A

D

C

F

G

B

E

H

I

#

I

(H)

#

E

(B)

#

G

(D)

#

F

(D)

#

C

(A)

#

D

(B)

#

B

(A)

#

A

(H)

Propagacin

$

A

D

C

F

G

B

E

H

I

$

H

(I)

$

B

(E)

$

D

(G)

$

D

(F)

$

A

(C)

$

B

(D)

$

A

(B)

$

H

(A)

Condiciones Iniciales

Nodos hoja no conocidos:

# (B

i

) = [1,1, ]

Nodos asignados (conocidos):

# (B

i

) = [0,0, ..1, 0, , 0] (1 para valor asignado)

$ (B

i

) = [0,0, ..1, 0, , 0] (1 para valor asignado)

Nodo raz no conocido:

$ (A) = P(A), (probabilidad marginal inicial)

Ejemplo

Enf.

Fiebre Dolor

Comida

P(F|E)

0.9 0.5

0.1 0.5

P(D|E)

0.7 0.4

0.3 0.6

P(E|C)

0.9 0.7

0.1 0.3

P(C)

0.8 0.2

Ejemplo

Enf.

Fiebre Dolor

Comida

F=si

#=[1,0]

#=[1,1]

Ejemplo

Enf.

Fiebre Dolor

Comida

#

F

= [1,0] *

[.9 .5 |

.1 .5]

= [.9 .5]

#

D

= [1,1] *

[.7 .4 |

.3 .6]

= [1 1]

P(D|E)

0.7 0.4

0.3 0.6

P(F|E)

0.9 0.5

0.1 0.5

Ejemplo

Enf.

Fiebre Dolor

Comida

#(E) = [.9 .5] * [1 1]

= [.9 .5]

P(D|E)

0.7 0.4

0.3 0.6

P(F|E)

0.9 0.5

0.1 0.5

#(C) = [.9 .5] * [.9 .7|

.1 .3]

= [.86 .78]

P(E|C)

0.9 0.7

0.1 0.3

Ejemplo

Enf.

Fiebre Dolor

Comida

$(E) = [.8 .2] * [.9 .7|

.1 .3]

= [.86 .14]

P(D|E)

0.7 0.4

0.3 0.6

P(F|E)

0.9 0.5

0.1 0.5

$(C) = [.8 .2]

P(E|C)

0.9 0.7

0.1 0.3

Ejemplo

Enf.

Fiebre Dolor

Comida

$(E) = [.86 .14]

P(D|E)

0.7 0.4

0.3 0.6

$(C) = [.8 .2]

$(D) = [.86 .14] * [.9 .5]

[.7 .4|

.3 .6]

= [.5698 .2742]

Ejemplo

Enf.

Fiebre Dolor

Comida $(E) = [.86 .14]

$(C) = [.8 .2]

$(D) = [.57 .27]

#(D)=[1,1]

#(E) = [.9 .5]

#(C) = [.86 .78]

P(C)="[.688 .156]

P(C)= [.815 .185]

P(E)="[.774 .070]

P(E)= [.917 .083]

P(D)="[.57 .27]

P(D)= [.67 .33]

Tarea

Leer sobre redes bayesianas (captulo en la

pgina)

You might also like

- Contaminación Ambiental - PerúDocument2 pagesContaminación Ambiental - PerúTania FigueroaNo ratings yet

- Validación Del ParqueDocument2 pagesValidación Del ParqueTania FigueroaNo ratings yet

- Los Verbos ModalesDocument2 pagesLos Verbos ModalesTania FigueroaNo ratings yet

- Los Verbos ModalesDocument2 pagesLos Verbos ModalesTania FigueroaNo ratings yet

- SQL V2Document5 pagesSQL V2Tania FigueroaNo ratings yet

- Los Verbos ModalesDocument1 pageLos Verbos ModalescrivoyturNo ratings yet

- LimaDocument1 pageLimaTania FigueroaNo ratings yet

- Tra Ducci OnDocument3 pagesTra Ducci OnTania FigueroaNo ratings yet

- R Rec M.1822Document16 pagesR Rec M.1822Tania FigueroaNo ratings yet

- R RecDocument7 pagesR RecTania FigueroaNo ratings yet

- Tutorial Enlazar Bases de Datos Desde Cero 3 CapasDocument46 pagesTutorial Enlazar Bases de Datos Desde Cero 3 CapasdafdAleNo ratings yet

- R Rec M.1822Document16 pagesR Rec M.1822Tania FigueroaNo ratings yet

- 9Document19 pages9WILLIANVVNo ratings yet

- Redes BayesianasDocument28 pagesRedes BayesianasGGA1976No ratings yet

- Informe Final Proyecto Atn/Fg-9141-RsDocument69 pagesInforme Final Proyecto Atn/Fg-9141-RsTania FigueroaNo ratings yet

- Informe MultinacionalesDocument22 pagesInforme MultinacionalesTania FigueroaNo ratings yet

- RespuestasDocument5 pagesRespuestasTania Figueroa67% (3)

- Proyecto de Complementación HumanaDocument5 pagesProyecto de Complementación HumanaH Fernando BlasónNo ratings yet

- MERCOSURDocument95 pagesMERCOSURInés RomanoNo ratings yet

- Ricoleto BerocayDocument32 pagesRicoleto BerocaymaestranattyNo ratings yet

- Análisis de La Cultura Organizacional GLORIADocument3 pagesAnálisis de La Cultura Organizacional GLORIAPérou AppleNo ratings yet

- Formulario para La Devolucion de Equipo Por Retiro o Desercion Del LiceoDocument2 pagesFormulario para La Devolucion de Equipo Por Retiro o Desercion Del LiceoJose ManzanarezNo ratings yet

- PDF Informe Plasticidad de Los SuelosDocument8 pagesPDF Informe Plasticidad de Los SuelosDENNIS ALBERTH HUANCA CONCHANo ratings yet

- Primer Reporte - Dunand, Brito, Rodríguez - Celda GalvánicaDocument6 pagesPrimer Reporte - Dunand, Brito, Rodríguez - Celda GalvánicaLuis BritoNo ratings yet

- CampanaUT VF60 80 90 INOX 2M Manual 1Document2 pagesCampanaUT VF60 80 90 INOX 2M Manual 1Rodrigo RNo ratings yet

- HOJADEVIDAautomotrizDocument4 pagesHOJADEVIDAautomotrizGarvin Alberto Sandrea ParisNo ratings yet

- 51n Matemáticas VDocument35 pages51n Matemáticas Vjuanchoo calzadaNo ratings yet

- Influencia de La Temperatura Sobre La Presión Ejercida Por Un GasDocument6 pagesInfluencia de La Temperatura Sobre La Presión Ejercida Por Un GasElvis AguilarNo ratings yet

- Fuente de Poder de Una PCDocument31 pagesFuente de Poder de Una PCSoledad Paricollo GutierrezNo ratings yet

- Demencia Por Cuerpos de LEWYDocument7 pagesDemencia Por Cuerpos de LEWYcamila ochoaNo ratings yet

- Presentacion Enfermedad de ChagasDocument9 pagesPresentacion Enfermedad de ChagasFrancisco Carrillo BrenesNo ratings yet

- Guía de Ejercicios ElectromagnétismoDocument4 pagesGuía de Ejercicios Electromagnétismojakecito uwuNo ratings yet

- Orientacion FamiliarDocument6 pagesOrientacion FamiliarJOSELYN GRACIELA YTURRALDE COELLONo ratings yet

- El Origen de La Vida Hipotesis Acerca Del Origen de La Vida - Generación Espontánea y Biogenesis.Document7 pagesEl Origen de La Vida Hipotesis Acerca Del Origen de La Vida - Generación Espontánea y Biogenesis.nando fernandoNo ratings yet

- Calculo para Balanceo de Caudales y Presiones DiferencialesDocument54 pagesCalculo para Balanceo de Caudales y Presiones DiferencialesWilliamBolivarHuaracha100% (3)

- Msds Unicaz Unizinc Epox 900Document6 pagesMsds Unicaz Unizinc Epox 900Wilmer Ruiz SalvatierraNo ratings yet

- 7 Hidrografía de AsiaDocument1 page7 Hidrografía de Asialiseth yuriana olivero alvearNo ratings yet

- Trabjo 1 Fase 5Document9 pagesTrabjo 1 Fase 5dayana gonzalesNo ratings yet

- EscamolesDocument7 pagesEscamolesstephany PérezNo ratings yet

- Jean Paul Margot La FelicidadDocument32 pagesJean Paul Margot La Felicidadroromero0% (1)

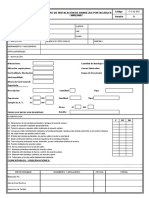

- F-CYE-047 Registro de Instalación de Bandejas - Rev2Document3 pagesF-CYE-047 Registro de Instalación de Bandejas - Rev2Carlo Lara100% (1)

- Mir 10 1819 06Document56 pagesMir 10 1819 06HacheNo ratings yet

- Necesidad Del Grado de Real Arco para El Maestro MasónDocument5 pagesNecesidad Del Grado de Real Arco para El Maestro Masóncarneirojimenez67% (3)

- Periodo Embrionario y FetalDocument3 pagesPeriodo Embrionario y FetalAngie Lucia Llerena TorresNo ratings yet

- Farmacotecnia Desarrollo Actividad 2Document8 pagesFarmacotecnia Desarrollo Actividad 2dayanaNo ratings yet

- CONSOLIDADO Grado Décimo. FísicaDocument5 pagesCONSOLIDADO Grado Décimo. Físicajaimecortes0129No ratings yet

- Manual de Seguridad en Silos Trabajo en Espacios Confinados y Atmc3b3sferas ExplosivasDocument104 pagesManual de Seguridad en Silos Trabajo en Espacios Confinados y Atmc3b3sferas ExplosivasRoberto Ahumada0% (1)