Professional Documents

Culture Documents

Short 5177242833387520 Document Tran Tat Dac Intern Report .1m

Uploaded by

Loc Do0 ratings0% found this document useful (0 votes)

5 views2 pagesOriginal Title

short_5177242833387520_document_tran_tat_dac_intern_report_.1m

Copyright

© © All Rights Reserved

Available Formats

PDF, TXT or read online from Scribd

Share this document

Did you find this document useful?

Is this content inappropriate?

Report this DocumentCopyright:

© All Rights Reserved

Available Formats

Download as PDF, TXT or read online from Scribd

0 ratings0% found this document useful (0 votes)

5 views2 pagesShort 5177242833387520 Document Tran Tat Dac Intern Report .1m

Uploaded by

Loc DoCopyright:

© All Rights Reserved

Available Formats

Download as PDF, TXT or read online from Scribd

You are on page 1of 2

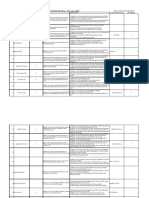

TRƯỜNG ĐẠI HỌC BÁCH KHOA HÀ NỘI CỘNG HÒA XÃ HỘI CHỦ NGHĨA VIỆT NAM

VIỆN CÔNG NGHỆ THÔNG TIN VÀ Độc Lập – Tự do – Hạnh phúc

TRUYỀN THÔNG ––––––––––––––––––––––––––––

––––––––––––

Hà Nội, ngày 15 tháng 9 năm 2020

BÁO CÁO

KẾT QUẢ THỰC TẬP TẠI ĐƠN VỊ NGOÀI TRƯỜNG

Kính gửi: Viện Công nghệ thông tin và Truyền thông, Đại học Bách khoa Hà Nội

Họ và tên sinh viên: Trần Tất Đắc

MSSV: 20172992

Lớp, Khóa:KHMT01-K62

Điện thoại: 0354892533

Email: dac.tt172992@sis.hust.edu.vn

Địa chỉ đến thực tập: Công ty TNHH công nghệ và truyền thông MDC Việt Nam

Thời gian được cử đi thực tập: từ ngày 22/6/2020 đến ngày 15/9/2020

Giáo viên phụ trách: Không

I. Nội dung công việc được giao:

- Đề tài : Phân biệt ảnh chứng minh thư thật/giả ứng dụng deep learning

- Nội dung thực hiện :

+ Tìm hiểu phương pháp thực hiện

+ Dữ liệu và training model

a. Các phương pháp giải quyết bài toán

Bài toán phân biệt ảnh chứng minh thư thật/giả được đưa về bài toán cơ bản phân loại ảnh nhị

phân. Đây là bài toán rất đặc trưng của thị giác máy tính nên có rất nhiều phương pháp được

áp dụng để giải quyết nhưng thường sẽ có 3 phần chính:

+Tiền xử lý ảnh : Đưa ảnh đầu vào về 1 kích thước cố định, chuẩn hóa, biến đổi hệ

màu, và áp dụng thêm các phương pháp tăng cường dữ liệu : rotation, crop, flip,...

+Dùng 1 mạng CNN để trích xuất đặc trưng

+Đưa đặc trưng trích xuất qua các lớp kết nối đầy đủ(Fully connected) để phân lớp

Tuy phương pháp chung là như vậy, nhưng với bài toán đặc thù này thì áp dụng là khá khó

khăn về chọn phương pháp tiền xử lý ảnh, chọn mạng CNN và cả về dữ liệu

Sau khi tìm hiểu và được hướng dẫn đã thử các phương pháp sau:

+Tập dữ liệu CASIA v2 : cắt ảnh thành các mảnh 64x64, một mảnh nhỏ được gán nhãn

fake khi nó có chưa trên 1000px giả và trên 1000px thật ( dựa trên mask của ảnh giả để xác

định. Đưa qua các mạng CNN : resnet50, VGG16. Cuối cùng đưa qua 2 lớp FC(Fully

connected)

+Tập dữ liệu CASIA v1 : resize ảnh về kích thước 512x512, chuẩn hóa. Đưa qua mạng

CNN : resnet,VGG16. Cuối cùng đưa qua 2 lớp FC(Fully connected)

+Tập dữ liệu tự tạo ( khoảng 150 ảnh CMT, CCCD thật + 200 ảnh tự tạo bằng cách

ghép chữ, ghép ảnh) : Tiền xử lý tương tự như tập CASIA v2 + đổi hệ màu ( RGB, YCbCr).

Đưa qua mạng CNN : MobileNet v2.

b. Dữ liệu và training model

2 bộ dữ liệu CASIA v1 và v2 được cung cấp miễn phí tại :

https://www.kaggle.com/sophatvathana/casia-dataset

Về bộ dữ liệu tự tạo : ảnh CMT, CCCD thật được cung cấp bởi công ty, ảnh giả được tạo

bằng 2 cách : ghép chữ và ảnh vào 1 vài phôi gốc ( tạo thêm 1 mặt nạ đánh dấu vị trí thật/giả)

và chỉnh sửa ảnh thật bằng photoshop

Tất cả model đều được train bằng Google Colab

II. Kết quả thực hiện:

− Khi chưa có bộ dữ liệu tự tạo và phải thực hiện thử nghiệm với 2 bộ dữ liệu CASIA

v1 và v2 kết quả đạt được chỉ ở khoảng 60-70% accuracy trên validation set và tận 90-

95% accuracy trên training set, điều này cho thấy sự overfit rất lớn, dù có fineturn

model bằng các lớp dropout và normalization nhưng kết quả không tốt hơn

− Với bộ dữ liệu tự tạo, kết quả training rất tốt (99%) tuy nhiên chưa hiểu vì lí do gì mà

khả năng phân lớp của mạng lại khá tệ. Có thể do các bước hậu xử lý chưa được đúng

đắn, kết quả cuối cần dựa trên kết quả của nhiều ảnh nhỏ.

III. Tự đánh giá kết quả thực tập:

− Ưu điểm: Trải qua quá trình thực tập đã có học hỏi được nhiều kiến thức và kinh

nghiệm trong lĩnh vực deep learning nói chung và computer vision nói riêng, được

trải nghiệm làm việc trong môi trường doanh nghiệp chuyên nghiệp. Suốt quá

trình thực tập đã được các anh/chị trong công ty hỗ trợ rất nhiều.

− Nhược điểm: kết quả sau quá trình thực hiện chưa được tốt, chưa thể gọi là hoàn

thiện. Bản thân cảm thấy chưa thực sự cố gắng hết mình.

SINH VIÊN

(Ký và ghi rõ họ tên)

Đắc

Trần Tất Đắc

XÁC NHẬN CỦA NƠI THỰC TẬP XÁC NHẬN CỦA VIỆN CNTT-TT

(Ký, ghi rõ họ tên, đóng dấu)

You might also like

- Bao Cao TKNhungDocument39 pagesBao Cao TKNhungLoc DoNo ratings yet

- HDSDProtocolServerBKRad - VII (30 10 2015)Document14 pagesHDSDProtocolServerBKRad - VII (30 10 2015)Loc DoNo ratings yet

- Embedded System (VI)Document6 pagesEmbedded System (VI)Loc DoNo ratings yet

- Short 2022-02-12 5204352922812416 Bao Cao Projecti He Thong Nhan Dien CMT CCCD 1.0mDocument10 pagesShort 2022-02-12 5204352922812416 Bao Cao Projecti He Thong Nhan Dien CMT CCCD 1.0mLoc DoNo ratings yet

- C3Document7 pagesC3Loc DoNo ratings yet

- Specification Group6Document13 pagesSpecification Group6Loc DoNo ratings yet

- Nhom5 BCGKDocument47 pagesNhom5 BCGKLoc DoNo ratings yet

- An Toan DienDocument67 pagesAn Toan DienLoc DoNo ratings yet

- Embedded SystemDocument27 pagesEmbedded SystemLoc DoNo ratings yet

- Nhom5 BCGK 05 reviewNGUYENTIENDATDocument73 pagesNhom5 BCGK 05 reviewNGUYENTIENDATLoc DoNo ratings yet

- SlideDocument40 pagesSlideLoc DoNo ratings yet

- Tia X Tuong Tac Voi Vat ChatDocument55 pagesTia X Tuong Tac Voi Vat ChatLoc DoNo ratings yet

- Chuong 3 Mach Khuech Dai Tin Hieu Nho Su Dung BJTDocument20 pagesChuong 3 Mach Khuech Dai Tin Hieu Nho Su Dung BJTLoc DoNo ratings yet

- Short 4983959976935424 Document Datn Tathiminhhuyen .7mDocument10 pagesShort 4983959976935424 Document Datn Tathiminhhuyen .7mLoc DoNo ratings yet

- Nhom27 Quan Ly Danh BaDocument24 pagesNhom27 Quan Ly Danh BaLoc DoNo ratings yet

- So Do Chuc NangDocument1 pageSo Do Chuc NangLoc DoNo ratings yet

- Bao Cao LTNC Le Quang MinhDocument43 pagesBao Cao LTNC Le Quang MinhLoc DoNo ratings yet

- Báo CáoDocument14 pagesBáo CáoLoc DoNo ratings yet

- (20 point) Một hệ thống thông tin di động yêu cầu: Assignment 2 BT1Document2 pages(20 point) Một hệ thống thông tin di động yêu cầu: Assignment 2 BT1Loc DoNo ratings yet

- Chuong 4 Mach Khuech Dai Tin Hieu Nho Su Dung FetDocument20 pagesChuong 4 Mach Khuech Dai Tin Hieu Nho Su Dung FetLoc DoNo ratings yet

- Bài tập lớn môn HTVT- Học kì 20211-Lớp 129254Document3 pagesBài tập lớn môn HTVT- Học kì 20211-Lớp 129254Loc DoNo ratings yet

- Mau de Thi - SVDocument1 pageMau de Thi - SVLoc DoNo ratings yet